FabImage® Studio Professional

Software für die Bildverarbeitungsingenieure

Hauptvorteile

- Keine speziellen Programmierkenntnisse erforderlich.

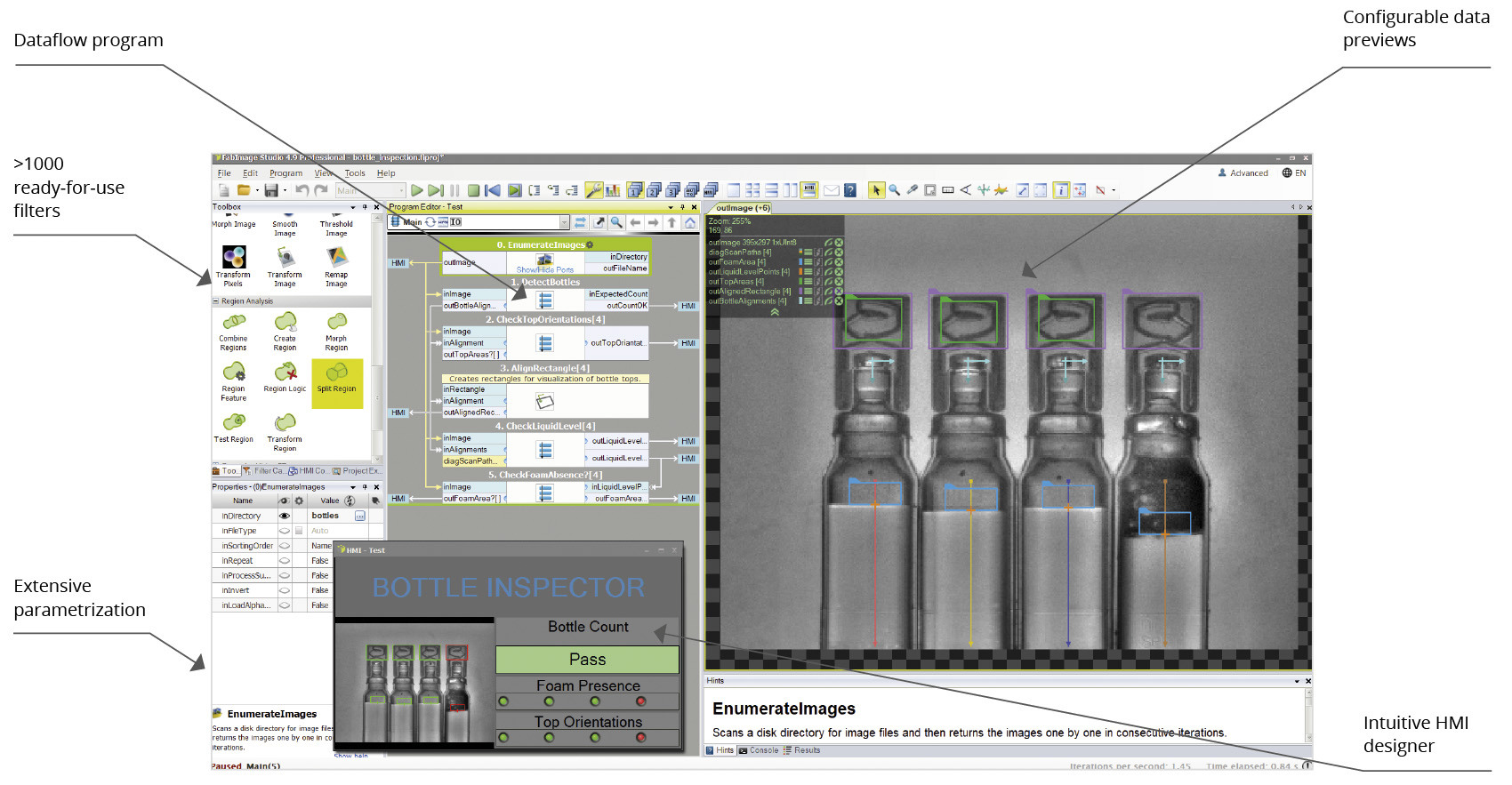

- Datenflussbasierte Software.

- Schneller und optimierter Algorithmus.

- Mehr als 1000 Hochleistungs-Funktionen.

- Kundenspezifische Filter für die Bildverarbeitung.

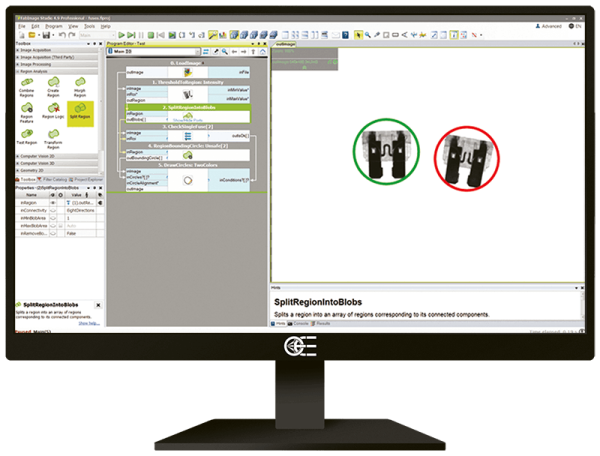

FabImage® Studio Professional ist eine Datenfluss-basierte Software, die für Bildverarbeitungstechniker entwickelt wurde. Sie erfordert keine Programmierkenntnisse und ist dennoch so leistungsstark, dass sie auch mit Lösungen, die auf Low-Level-Programmierbibliotheken basieren, überzeugen kann.

Außerdem ist die Architektur sehr flexibel, weshalb der Benutzer das Produkt leicht an seine Arbeitsweise und die spezifischen Anforderungen der unterschiedlichen Projekte anpassen kann.

Beispiele für reale Anwendungen und Fallgeschichten

Vorwort

Deep Learning Add-on ist eine bahnbrechende Technologie für die Bildverarbeitung. Es handelt sich um einen Satz von fünf vorgefertigten Werkzeugen, die mit 20 bis 50 Beispielbildern trainiert werden und dann Objekte, Fehler oder Merkmale automatisch erkennen. Intern werden große neuronale Netze verwendet, die von unserem Forschungsteam für den Einsatz in industriellen Bildverarbeitungssystemen entwickelt und optimiert wurden.

Zusammen mit Fabimage Studio Professional erhalten Sie eine Komplettlösung für die Schulung und Bereitstellung moderner Bildverarbeitungsanwendungen.

Hauptvorteile

TRAININGSDATEN

Typische Anwendungen erfordern zwischen 20 und 50 Bilder für das Training. Je mehr desto besser, aber unsere Software lernt intern wichtige Merkmale aus einem begrenzten Trainingssatz und generiert dann Tausende neuer künstlicher Proben für ein effektives Training.

AUSRÜSTUNG

Für ein effektives Training ist eine moderne GPU erforderlich. In der Produktion können Sie entweder GPU oder CPU verwenden. Die GPU ist normalerweise 3-10 mal schneller (mit Ausnahme der Objektklassifizierung, die auf der CPU gleich schnell ist).

GESCHWINDIGKEIT

Die typische Trainingszeit auf einer GPU beträgt 5-15 Minuten. Die Inferenzzeit variiert je nach Werkzeug und Hardware zwischen 5 und 100 ms pro Bild. Die höchste Leistung garantiert WEAVER, eine industrielle Inferenzmaschine.

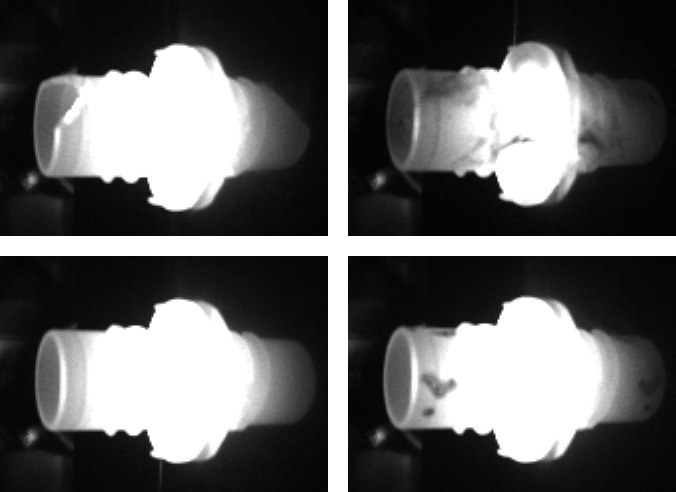

Trainingsprozess

1. Bilder erheben und normalisieren

- Beschaffen Sie 20 - 50 Bilder, die richtige und unrichtige Beispiele schildern und alle möglichen Abarten der Objekte darstellen; speichern Sie sie auf der Platte.

- Sorgen Sie dafür, dass die Skala, die Orientierung und die Beleuchtung möglichst einheitlich sind.

Training

- Öffnen Sie das FabImage Studio Professional und aktivieren Sie eines der Deep Learning Add-on-Tools

- Öffnen Sie einen mit dem Tool verknüpften Editor und laden Sie Ihre Trainingsbilder in das Programm rein

- Sie können Ihre Bilder beschriften oder Markierungen mit Zeichenwerkzeugen hinzufügen

- Klicken Sie auf "Train" (Trainieren)

Trainings- und Validierungsdaten

Beim tiefen Lernen und in sonstigen Bereichen des maschinellen Lernens ist die Anwendung der richtigen Methodik von besonderer Bedeutung. Am wichtigsten ist es, die Trainingsdaten von den Validierungsdaten abzutrennen. Die Trainingsdaten sind eine Aufstellung von Bildern, die genutzt wird, um das Modell zu trainieren. Diese Daten können für die Leistungsmessung des Modells nicht angewendet werden, denn im Endresultat werden unrealistisch gute Ergebnisse geliefert. Daher ist es notwendig, eine separate Datensammlung, d.h. Validierungsdaten zu nutzen, um das Modell richtig einzuschätzen. Unser Tool für das tiefe Lernen bildet beide Datensammlungen auf Basis der Bilder, welch durch den Nutzer benennt werden.

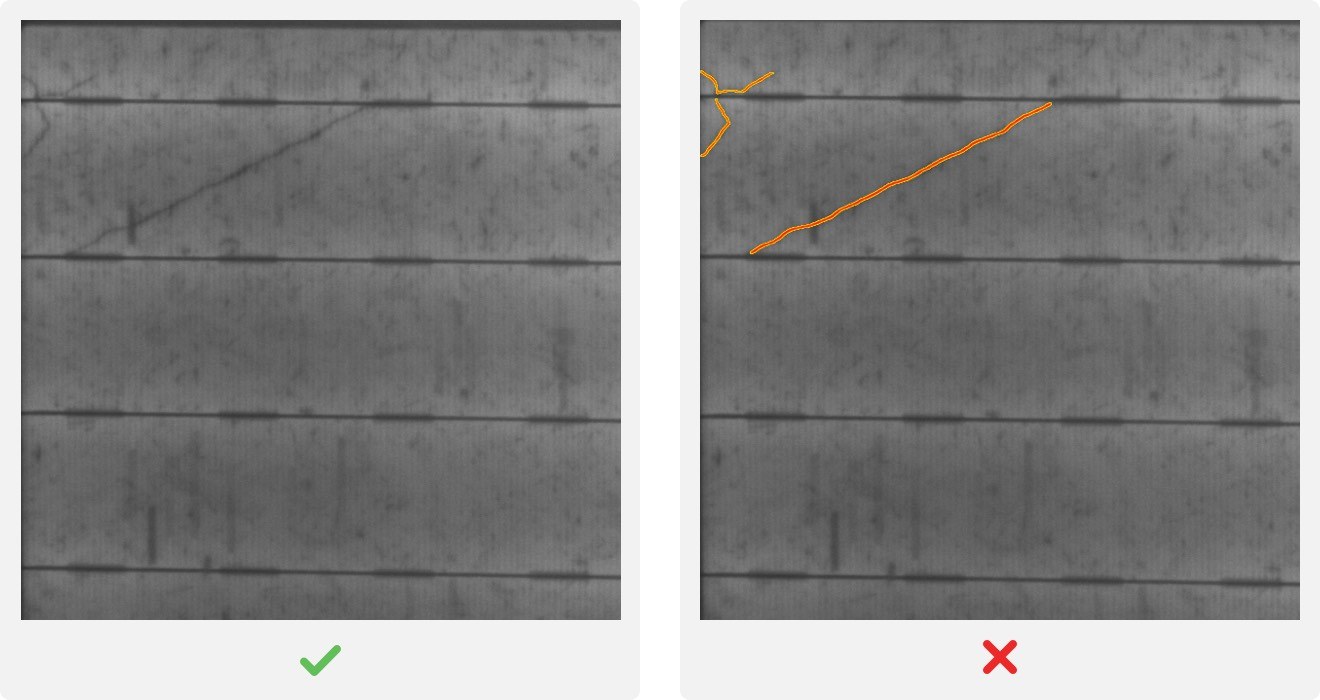

Merkmalserkennung

Beim Vorgang mit Überwachung hat der Nutzer Pixel zu markieren, welche die Defekte auf den Trainingsbildern darstellen. Unser Tool lernt, richtige und richtige Merkmale durch die Beobachtung ihrer grundlegenden Eigenschaften zu unterscheiden.

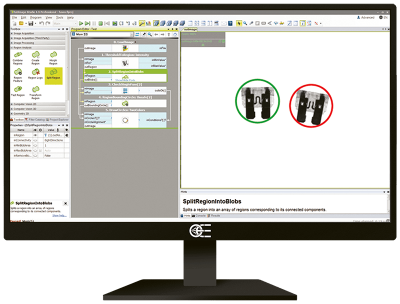

Inspektion von Photovoltaikmodulen

Bei dieser Anwendung müssen Risse und Kratzer auf einer Oberfläche mit komplexen Merkmalen erkannt werden. Bei herkömmlichen Methoden erfordert dies komplizierte Algorithmen mit Dutzenden von Parametern, die für jeden Paneltyp geändert werden müssen. Mit dem Deep Learning Add-on reicht es aus, das System im überwachten Modus mit einem einzigen Tool zu trainieren.

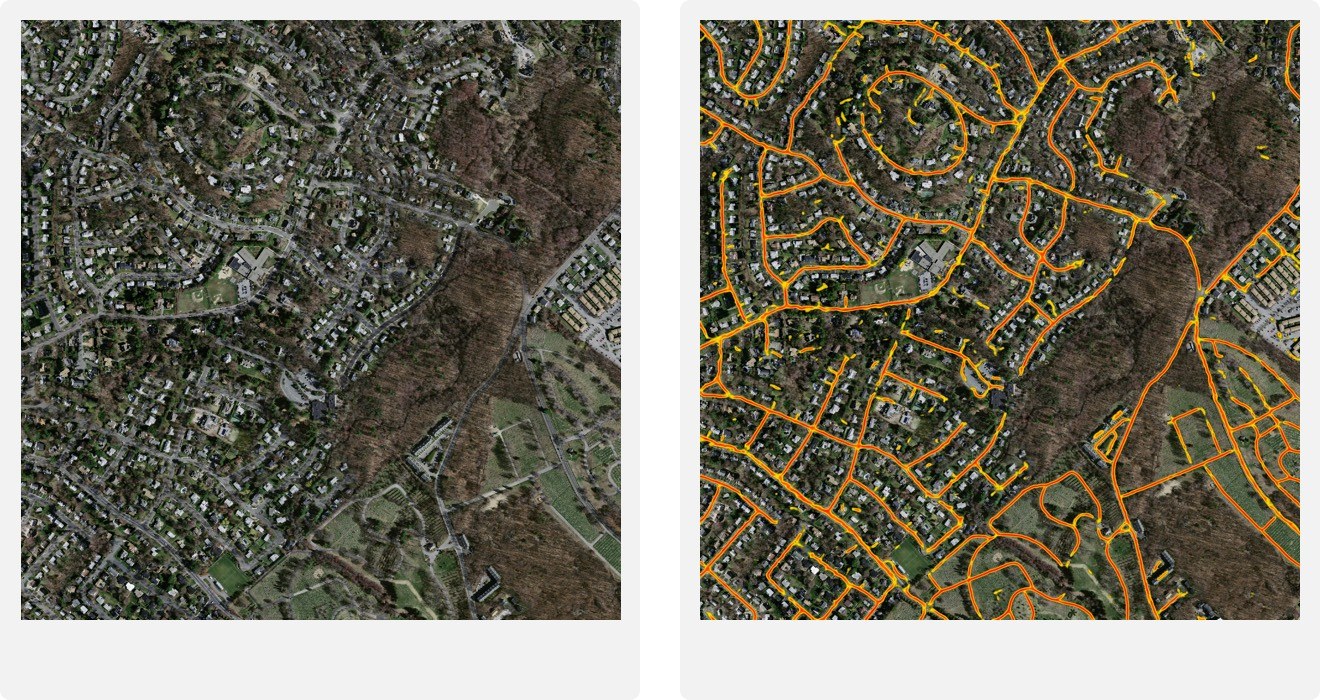

Segmentierung der Satellitenbilder

In Hinsicht auf das Vorkommen mehrerer unterschiedlicher Elemente lassen sich die Satellitenbilder schwierig analysieren. Unser Deep Learning Modul kann austrainiert werden, um Straßen und Gebäude mit höchster Präzision zu erkennen. Das Training kann mittels eines richtig markierten Bildes durchgeführt werden, und die Ergebnisse sind sofort überprüfbar. Legen Sie mehr markierte Proben bei, um die Richtigkeit des Modells zu steigern.

Erkennung von Anomalien

Im Vorgang ohne Überwachung ist der Trainingsprozess einfacher. Eine konkrete Definition des Defekts besteht hier nicht: das Tool wird mittels der richtigen Proben trainiert. Auf ihrer Basis werden sämtliche Abweichungen auf geprüften Bildern gezeigt.

Überprüfung von Verpackungen

Wenn eine Sushi-Packung dem Verkäufer geliefert wird, müssen sich alle Elemente in einer bestimmten Lage befinden. Es ist schwierig, Defekte zu definieren, wenn die Form der richtigen Stücke auch variieren kann. Das Problem lässt sich lösen, indem man das tiefe Lernen ohne Überwachung anwendet, wodurch alle bedeutenden Abweichungen davon erkannt werden, was das Tool im Training gelernt hat.

Kunststoffe, Spritzgussformen

Das Ausformen im Spritzgussverfahren ist ein komplizierter Prozess, in dessen Ablauf mehrere Probleme entstehen können. Gegenstände, die aus Kunststoff hergestellt werden, können für das Biegen bzw. andere Deformationen anfällig sein, welche für den Kunden akzeptabel sind. Unser Deep Learning Modul kann auf Basis der gelieferten Proben alle akzeptablen Verformungen lernen, und anschließend allerlei Abweichungen an der Produktionsanlage erkennen.

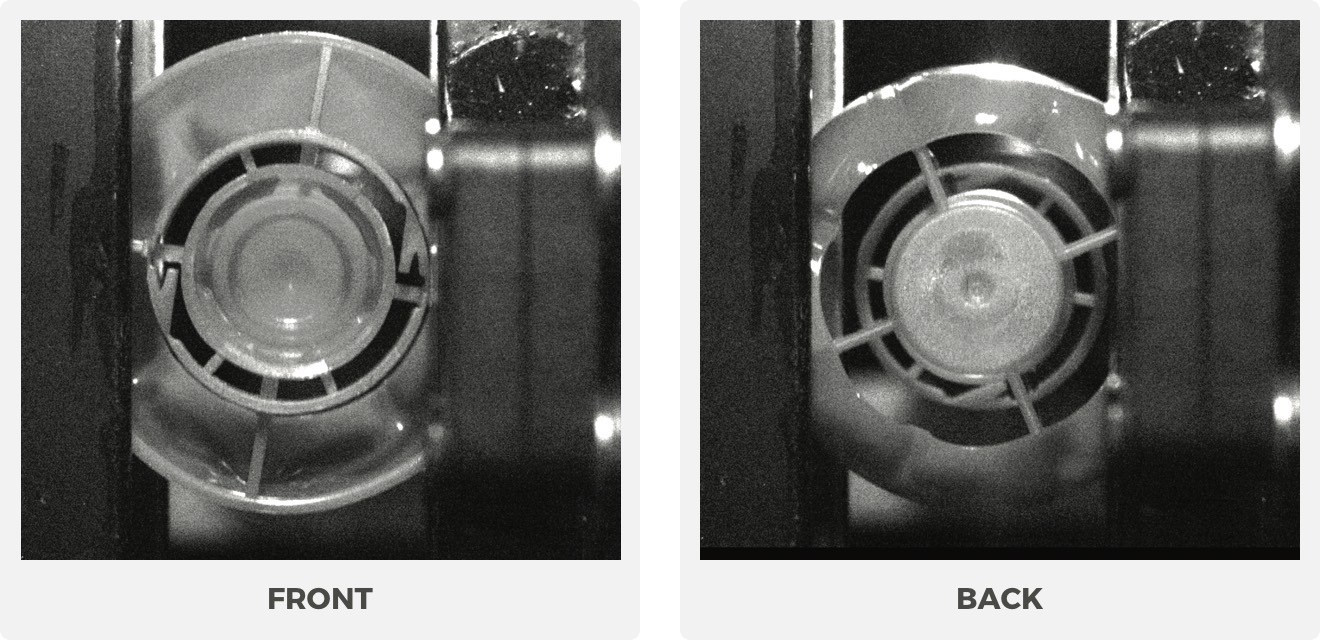

Objektklassifizierung

Das Objektklassifizierungswerkzeug unterteilt Eingabebilder in Gruppen, die vom Benutzer entsprechend ihrer besonderen Merkmale erstellt wurden. Als Ergebnis werden der Name einer Klasse und das Klassifizierungsvertrauen angegeben.

Kunststoffkappen: vorne oder hinten

Kunststoffkappen können manchmal versehentlich in der Produktionsmaschine umdrehen. Der Kunde möchte diese Situation erkennen. Die Aufgabe kann mit herkömmlichen Methoden erledigt werden, erfordert jedoch einen Experten, um einen bestimmten Algorithmus für diese Anwendung zu entwerfen. Auf der anderen Seite können wir eine Deep-Learning-basierte Klassifizierung verwenden, die automatisch lernt, Vorder- und Rückseite anhand einer Reihe von Trainingsbildern zu erkennen.

3D Leichtmetallrad Identifikation

In einem Werk können Hunderte verschiedener Leichtmetallradtypen hergestellt werden. Die Identifizierung eines bestimmten Modells mit solchen Modellmengen ist mit herkömmlichen Methoden praktisch unmöglich. Das Anpassen von Vorlagen würde sehr viel Zeit in Anspruch nehmen, um Hunderte von Modellen abzugleichen, während die Herstellung maßgeschneiderter Modelle einfach zu viel Entwicklung und Wartung erfordern würde. Deep Learning ist eine ideale Lösung, die direkt aus Beispielbildern ohne maßgeschneiderte Entwicklung lernt.

Instanzsegmentierung

Die Instanzsegmentierungstechnik wird verwendet, um einzelne oder mehrere Objekte innerhalb eines Bildes zu lokalisieren, zu segmentieren und zu klassifizieren. Im Gegensatz zur Merkmalerkennungstechnik erkennt diese Technik einzelne Objekte und kann sie möglicherweise trennen, selbst wenn sie sich berühren oder überlappen.

Nuss Segmentierung

Gemischte Nüsse sind ein sehr beliebtes Snack-Food, das aus verschiedenen Arten von Nüssen besteht. Da die prozentuale Zusammensetzung der Nüsse in einer Packung der Liste der auf der Packung aufgedruckten Zutaten entsprechen muss, möchten die Kunden sicherstellen, dass die richtige Menge an Nüssen jeder Art verpackt wird. Das Instanzsegmentierungswerkzeug ist eine ideale Lösung in einer solchen Anwendung, da es Masken zurückgibt, die den segmentierten Objekten entsprechen.

Überprüfung von Verpackungen

Ein typischer Satz Suppengrün, der in Europa verwendet wird, wird in zufälliger Position auf einem weißen Plastikteller verpackt. Produktionslinienarbeiter vergessen manchmal versehentlich, eines der Gemüse auf den Teller zu legen. Obwohl es ein System gibt, das die Platten wiegt, möchte der Kunde die Vollständigkeit des Produkts unmittelbar vor dem Versiegelungsprozess überprüfen. Da es keine zwei Gemüse gibt, die gleich aussehen, besteht die Lösung darin, eine auf tiefem Lernen basierende Segmentierung zu verwenden. In der Schulungsphase muss der Kunde lediglich Regionen markieren, die Gemüse entsprechen.

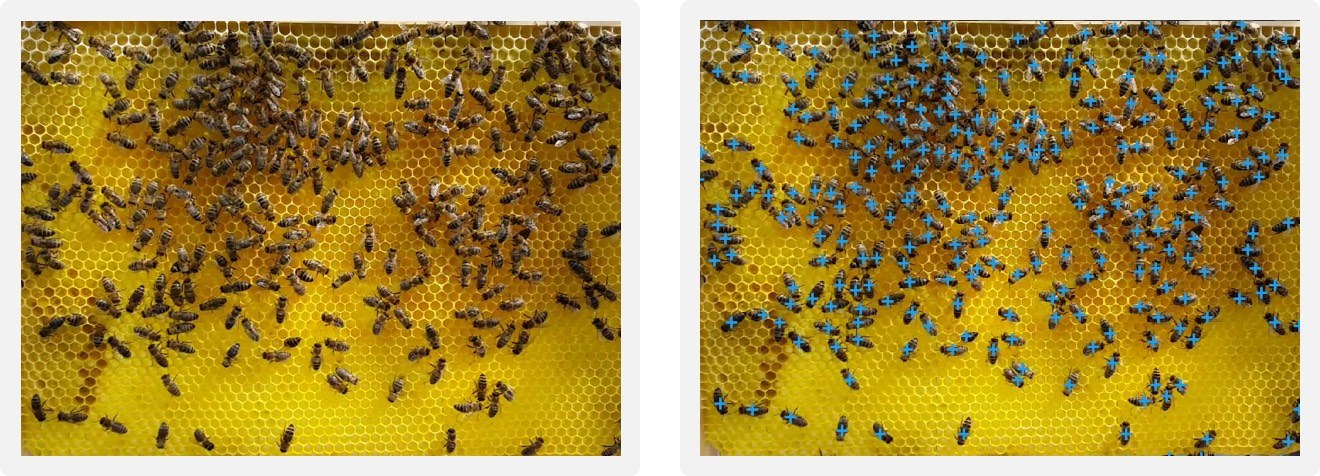

Punktorung

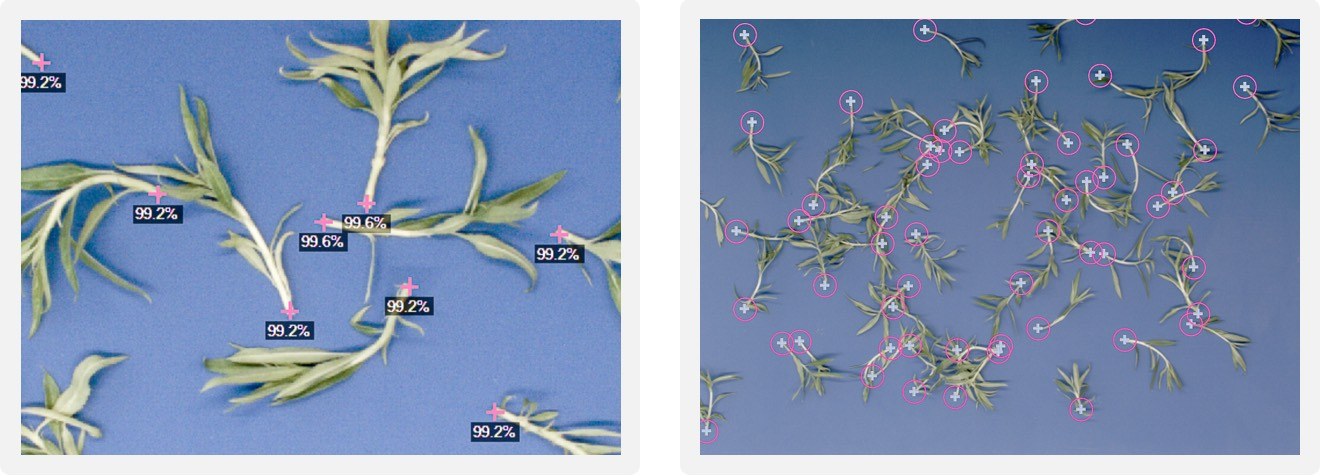

Das Werkzeug Punktposition sucht nach bestimmten Formen, Merkmalen oder Markierungen, die als Punkte in einem Eingabebild identifiziert werden können. Es kann mit dem herkömmlichen Template-Matching verglichen werden, aber hier wird das Tool mit mehreren Samples trainiert und wird robust gegen große Variabilität der interessierenden Objekte.

Bienen verfolgen

Die Aufgabe, die mit herkömmlichen Bildverarbeitungsmethoden unmöglich zu erfüllen scheint, kann mit unserem neuesten Tool erledigt werden. In diesem Fall verwenden wir es, um Bienen zu erkennen. Wenn dies erledigt ist, können wir überprüfen, ob sie durch Varroose infiziert sind - die Krankheit, die durch die parasitären Milben verursacht wird, die die Honigbienen angreifen. Der Parasit bindet sich an ihren Körper und aufgrund einer charakteristischen roten Entzündung können wir ihn nach seinem Gesundheitszustand klassifizieren. Dieses Beispiel zeigt nicht nur, dass es eine einfache Lösung für eine komplexe Aufgabe ist, sondern dass wir auch für viele verschiedene Industriezweige offen sind, z. Landwirtschaft.

Pick-and-Place

In diesen Anwendungen müssen wir einen Roboterarm führen, um Gegenstände aufzunehmen, typischerweise von einem Förderband oder von einem Behälter. Ein gutes Beispiel für eine solche Anwendung ist das Pflücken kleiner Stecklinge und das vertikale Einsetzen in Töpfe. Ungenauigkeiten bei der Erkennung können dazu führen, dass sie zu tief oder verkehrt herum gepflanzt werden, was dazu führt, dass Stecklinge keine Wurzeln bilden. Unsere Deep-Learning-Tools ermöglichen es, die gewünschten Pflanzenteile schnell zu lokalisieren und genaue Ergebnisse zu liefern, die für diesen Vorgang erforderlich sind.

Drei Lizenztypen sind verfügbar:

Developer Lizenzen: Dieser Lizenztyp wird für die Entwicklung eines Bildverarbeitungsprogramms benötigt.

Runtime Lizenzen: Dieser Lizenztyp ist für die Ausführung eines Bildverarbeitungsprogramms erforderlich. Um eine Laufzeitlizenz zu erwerben, müssen Sie eine Developer Lizenz erworben haben.

Add-on Lizenzen: Zusätzliche Lizenzen, mit denen Sie die Funktionalität der beiden anderen Lizenztypen erweitern können.

Developer Lizenzen

Basis Lizenz

Die Developer Lizenz ist einem einzelnen Entwickler-Benutzer zugewiesen und kann nur über einen USB-Dongle aktiviert werden.

In den ersten 12 Monaten nach der Aktivierung sind kostenlose technische Supportleistungen enthalten, wie z.B.:

- Die aktuellste Version der Software mit den dazugehörigen neuen Funktionen und Dokumentationen*

- Antworten auf technische Fragen zur Nutzung der Software per E-Mail

Nach Ablauf von 12 Monaten nach der Aktivierung der Developer-Lizenz ist es notwendig, eine Service-Lizenz (FIS-EXT) zu erwerben, um:

| * Um die aktuellste Version der Software zu erhalten, müssen Sie Opto Engineering die mit dem USB-Dongle der gewünschten Lizenz verbundene WIBU-Datei zusenden. Erfahren Sie mehr darüber, wie und wo Sie die WIBU-Datei herunterladen können unter https://docs.fab-image.com/stu... | |||

Art.-Nr. |

Beschreibung |

Kategorie |

Merkmale |

FIS-PRO |

FabImage® Studio |

Developer Basis Lizenz |

Entwicklungsumgebung (IDE) für die Programmierung in grafischer Form.

|

USB-DONGLE-FI |

USB Dongle |

Hardware |

Erforderlich für die Aktivierung der Lizenz über einen Hardware-USB-Dongle. |

ADD-ON Lizenzen

ADD-ON-Lizenzen** sind zusätzliche Lizenzen, mit denen Sie die Funktionalität der Basis Lizenz erweitern können. Um ADD-ON Lizenzen zu erwerben, müssen Sie eine FabImage® Studio Developer Lizenz (FIS-PRO) erworben haben.

| ** Um eine ADD-ON-Lizenz zu bestellen, müssen Sie auch die WIBU-Datei senden, die mit dem USB-Dongle der Developer Lizenz verbunden ist, für die Sie das Add-on aktivieren möchten. Lesen Sie mehr darüber, wie und wo Sie die WIBU-Datei herunterladen können unter diesem link: https://docs.fab-image.com/stu... |

|||

| *** Es ist nicht möglich, mehrere Makrofilter mit Deep Learning zu erstellen, die parallel arbeiten. | |||

Art.-Nr. |

Beschreibung |

Kategorie |

Merkmale |

FIS-CODE-ADD |

Code-Generator für Kunden, die |

Developer ADD-ON Lizenz |

Ermöglicht die Umwandlung von in FabImage® Studio Professional (FIS-PRO) erstellten Anwendungen in C++ Code. Das Paket FabImage® Studio + Code Generator ADD-ON (FIS-PRO + FIS-CODE-ADD) ermöglicht dem Anwender die Integration und Nutzung der FabImage® Library Suite (FIL-SUI). Der Benutzer kann die Entwicklungsumgebung entweder für die grafische Programmierung oder die direkte Programmierung in C++ oder .NET verwenden. Um eine Applikation laufen zu lassen, reicht es aus, eine Runtime (FIS-RUN oder FIL-RUN) zu erwerben. |

FIS-PAR-ADD |

Parallelverarbeitung ADD-ON |

Developer ADD-ON Lizenz |

Ermöglicht dem Benutzer:

|

FI-DL-ADD |

FabImage® Deep Learning ADD-ON |

Developer ADD-ON Lizenz |

Ermöglicht dem Benutzer die Verwendung von Deep Learning Tools ***. |

Runtime Lizenzen

Runtime Lizenz SINGLE THREAD

Die Runtime Lizenz ist einem einzelnen Bildverarbeitungssystem zugeordnet und erlaubt die Erfassung mehrerer Kameras und die sequentielle Ausführung von Prozessen (Makrofiltern) (single thread).

Sie kann über zwei Optionen aktiviert werden:

USB Dongle (USB-DONGLE-RUN)

Computer ID*

Um eine Single-Thread Runtime Lizenz zu erwerben, müssen Sie die FabImage® Studio Developer Lizenz (FIS-PRO) erworben haben.

| * Sollte die Lizenz durch Beschädigung des Computers, dem sie durch die Computer-ID zugewiesen ist, verloren gehen, muss eine neue erworben werden. Opto Engineering empfiehlt die Option, die Lizenz über einen USB-Dongle zu erwerben. | |||

Art.-Nr. | Beschreibung | Kategorie | Merkmale |

FIS-RUN | FabImage® Studio Runtime | Runtime Lizenz

| Erlaubt es Ihnen, eine unbegrenzte Anzahl von Prozessen (Makrofiltern) sequentiell auszuführen. Ein besonderer Vorteil dieser Lizenz besteht darin, dass Änderungen, wie z. B. das Ändern und Nachladen von Rezepten, auch direkt an der Produktionslinie leicht vorgenommen werden können. |

USB-DONGLE-RUN | USB Dongle (Optional) | Hardware | Die Lizenz wird über einen USB-Dongle aktiviert. |

Runtime Lizenz MULTITHREADING

Um die Parallel Processing (FIS-PAR-ADD) Funktionen nutzen zu können, müssen Sie eine der folgenden Runtime Lizenzen erwerben. Diese Runtimes ersetzen die FabImage® Library Single-Thread Runtime (FIS-RUN).

Um eine Multithreading Runtime Lizenz zu erwerben, müssen Sie eine Developer FabImage® Studio (FIS-PRO) und eine Developer Parallel Processing ADD-ON Lizenz (FIS-PAR-ADD) erworben haben.

| * Um eine unbegrenzte Anzahl von Prozessen parallel laufen zu lassen, empfiehlt es sich, diejenige Runtime Lizenz zu erwerben, die der Anzahl der Kerne des Bildverarbeitungscomputers entspricht. | ||||

Art.-Nr. |

Beschreibung |

Kategorie |

Merkmale |

|

FIS-RUN-CL-XX* |

||||

FIS-RUN-CL-4 |

FabImage® Studio Runtime für einen 4-Kern- |

ADD-ON Runtime Lizenz |

Ermöglicht die parallele Ausführung einer unbegrenzten Anzahl von Prozessen. Erfordert einen PC mit 4 Kernen |

|

FIS-RUN-CL-6 |

FabImage® Studio Runtime für einen 6-Kern- |

ADD-ON Runtime Lizenz |

Ermöglicht die parallele Ausführung einer unbegrenzten Anzahl von Prozessen. Erfordert einen PC mit 6 Kernen |

|

FIS-RUN-CL-8 |

FabImage® Studio Runtime für einen 8-Kern- |

ADD-ON Runtime Lizenz |

Ermöglicht die parallele Ausführung einer unbegrenzten Anzahl von Prozessen. Erfordert einen PC mit 8 Kernen. |

|

FIS-RUN-CL-16 |

FabImage® Studio Runtime für einen 16-Kern-Bildverarbeitungsrechner |

ADD-ON Runtime Lizenz |

Ermöglicht die parallele Ausführung einer unbegrenzten Anzahl von Prozessen. Erfordert einen PC mit 16 Kernen |

|

FIS-RUN-TL-XX |

||||

FIS-RUN-TL-2 |

FabImage® Studio Runtime begrenzt auf 2 Threads |

ADD-ON Runtime Lizenz |

Ermöglicht die Verwendung von PCs mit einer beliebigen Anzahl von Kernen. Die Anzahl der parallelen Prozesse ist auf 2 Threads begrenzt |

|

FIS-RUN-TL-4 |

FabImage® Studio Runtime begrenzt auf 4 Threads |

ADD-ON Runtime Lizenz |

Ermöglicht die Verwendung von PCs mit einer beliebigen Anzahl von Kernen. Die Anzahl der parallelen Prozesse ist auf 4 Threads begrenzt |

|

FIS-RUN-TL-6 |

FabImage® Studio Runtime begrenzt auf 6 Threads |

ADD-ON Runtime Lizenz |

Ermöglicht die Verwendung von PCs mit einer beliebigen Anzahl von Kernen. Die Anzahl der parallelen Prozesse ist auf 6 Threads begrenzt |

|

FIS-RUN-TL-8 |

FabImage® Studio Runtime begrenzt auf 8 Threads |

ADD-ON Runtime Lizenz |

Ermöglicht die Verwendung von PCs mit einer beliebigen Anzahl von Kernen. Die Anzahl der parallelen Prozesse ist auf 8 Threads begrenzt |

|

FIS-RUN-TL-16 |

FabImage® Studio Runtime begrenzt auf 16 Threads |

ADD-ON Runtime Lizenz |

Ermöglicht die Verwendung von PCs mit einer beliebigen Anzahl von Kernen. Die Anzahl der parallelen Prozesse ist auf 16 Threads begrenzt |

|

ADD-ON Runtime Lizenz DEEP LEARNING

Um die Deep Learning ADD-ON Funktionen nutzen zu können, muss zusätzlich zur FabImage® Studio Runtime (FIS-RUN) die folgende Runtime Lizenz erworben werden.

Um die Deep Learning ADD-ON Runtime zu erwerben, müssen Sie eine FabImage® Studio Developer Lizenz (FIS-PRO) und eine Developer Deep Learning ADD-ON Lizenz (FI-DL-ADD) erworben haben.

| * Es können nicht mehrere GPU-Karten für die Inferenz verwendet werden. | |||

Art.-Nr. | Beschreibung | Kategorie | Merkmale |

FIS-RUN-DL | FabImage® Studio Deep Learning Runtime ADD-ON | Deep Learning ADD-ON

| Ermöglicht dem Benutzer die Ausführung von Deep Learning* im Single-Thread-Modus |

Service Lizenz

Nach Ablauf von 12 Monaten nach der Aktivierung der FabImage® Studio Lizenz (FIS-PRO) oder der Developer ADD-ON Lizenzen (FIS-CODE-ADD, FIS-PAR-ADD und FI-DL-ADD), die folgenden Servicelizenzen können um weitere 12 Monate für technische Unterstützungsleistungen verlängert werden, die Folgendes beinhalten:

- Die aktuellste Version der Software mit den dazugehörigen neuen Funktionen und Dokumentationen- Antworten auf technische Fragen zur Nutzung der Software per E-Mail

| * Parallel-Add-on-Lizenzen erhalten beim Kauf einer FIS-EXT kostenlose Updates ** Beim Bezug der ADD-EXT, ist der Erwerb der FIS-EXT nicht zwingend erforderlich *** Für den Erwerb einer DL-EXT muss auch die FIS-EXT erworben werden. |

|||

Art.-Nr. | Beschreibung | Kategorie | Merkmale |

FIS-EXT | FabImage® Studio EXTENSION

| Service Lizenz | Lizenz erforderlich für:

|

ADD-EXT | FabImage® Studio + Code Generator ADD-ON EXTENSION | Service Lizenz | Lizenz erforderlich für:

|

DL-EXT* | FabImage® Deep Learning ADD-ON EXTENSION | Service Lizenz | Lizenz erforderlich für:

|

Wenn Sie die technischen Unterstützungsdienste nicht verlängern, können Sie trotzdem folgendes tun:

•Ihre Entwicklerlizenz (FIS-PRO) und Zusatzlizenzen (FIS-CODE-ADD, FIS-PAR-ADD und FI-DL-ADD) weiterverwenden, ausschließlich in der neuesten Version, die zum Zeitpunkt des Ablaufes des technischen Supports verfügbar war.

•Erwerb und Nutzung von Runtime-Lizenzen (einschließlich Multithreading- und Deep Learning-Lizenzen), jedoch nur in der neuesten Version, die zum Zeitpunkt des Ablaufes des technischen Supports verfügbar war.

WICHTIG

Opto Engineering veröffentlicht jährlich zwei bis vier neue Versionen von Entwicklerlizenzen, daher ist es sehr wahrscheinlich, dass nach Ablauf des Supports bereits eine neue Version verfügbar ist. Aus diesem Grund empfiehlt Opto Engineering neben der Möglichkeit, von unserem technischen Support zu profitieren, stets den Erwerb von Servicelizenzen.

Intuitiv

Drag & Drop

Die komplette Programmierung besteht in der Auswahl von Filtern und deren Kombination miteinander. Sie können sich voll und ganz auf die computergestützte Bildverarbeitung konzentrieren.

Sie können alles sehen

Die Inspektionsergebnisse werden in mehreren konfigurierbaren Datenvorschauen angezeigt, und wenn ein Parameter im Programm geändert wird, werden die Vorschauen in Echtzeit aktualisiert.

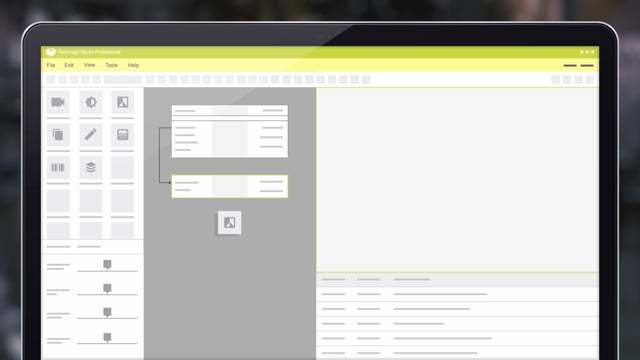

HMI Designer

Sie können auf einfache Weise benutzerdefinierte grafische Benutzeroberflächen erstellen und so die gesamte Bildverarbeitungsanwendung mit einem einzigen Softwarepaket erstellen.

Leistungsstark

Mehr als 1000 einsatzbereite Filter

Es stehen mehr als 1000 einsatzbereite Filter für die Bildverarbeitung zur Verfügung, die für Hunderte von Anwendungen getestet und optimiert wurden. Sie haben viele erweiterte Funktionen, wie z. B. Unterdrückung von Ausreißern, Subpixelpräzision oder beliebig geformte Untersuchungsbereiche.

Hardwarebeschleunigung

Die Filter sind in hohem Maße für die SSE-Technologie und für Multicore-Prozessoren optimiert. Unsere Umsetzungen gehören zu den schnellsten der Welt!

Schleifen und Bedingungen

Ohne eine einzige Code-Zeile zu schreiben, können Sie spezifische und skalierbare Programmabläufe erstellen. Schleifen, Bedingungen und Unterprogramme (Makrofilter) werden mit entsprechenden Datenflusskonstrukten grafisch realisiert.

Anpassbar

GigE Vision und GenTL-Unterstützung

FabImage® Studio ist ein GigE Version kompatibles Produkt, Es unterstützt die GenTL Schnittstelle, genauso wie eine Vielzahl von herstellerspezifischen APIs. Somit kann die Software mit Opto Engineering® Kameras und den meisten auf dem Markt erhältlichen Kameras benutzt werden. Eingeschlossen die Kameras von Matrix Vision, Allied Vision, Basler, Baumer, Dalsa, PointGrey, Photon Focus, XIMEA und anderen Herstellern.

Benutzerfilter

Sie können Filter verwenden, um Ihren eigenen C/C++ Code zu integrieren, und profitieren von der visuellen Programmierung.

C++ Code Generator

Mit FabImage® Studio erstellte Programme können als C++-Code oder .NET Assemblies exportiert werden. Deshalb können Sie sehr leicht Ihre Bildverarbeitungsalgorithmen mit Anwendungen kombinieren, die mit den Programmiersprachen C++, C# oder VB erstellt wurden.

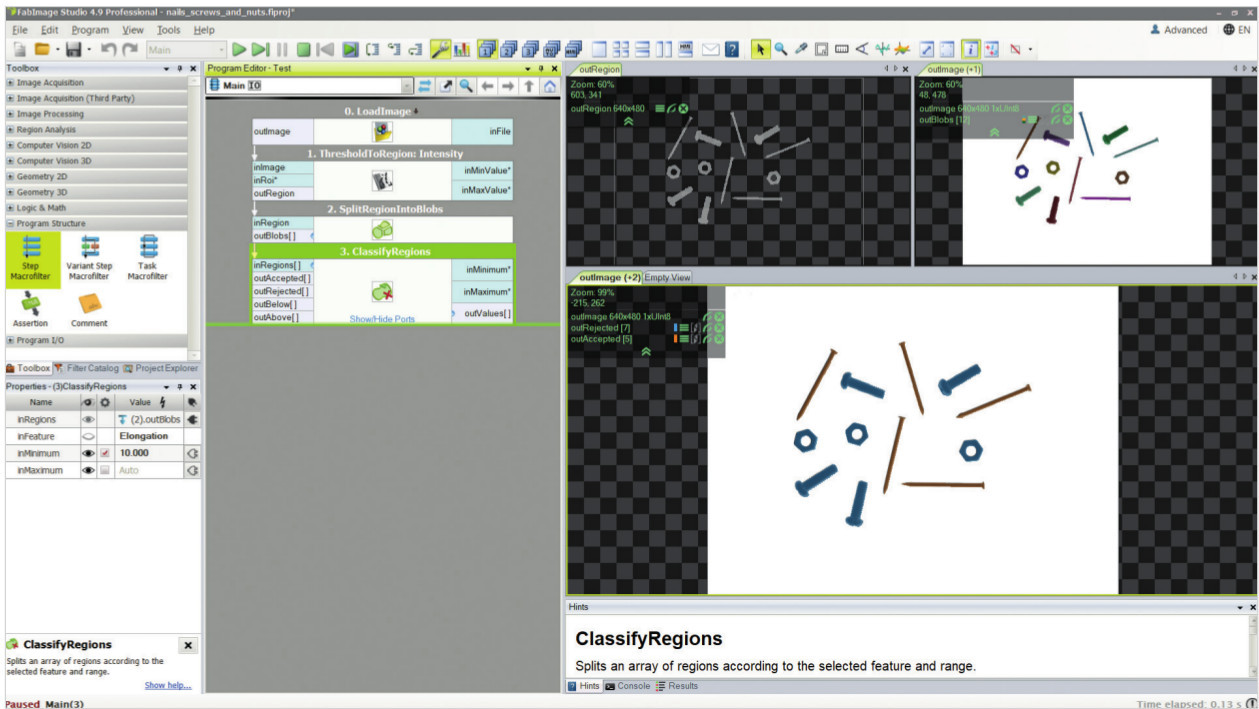

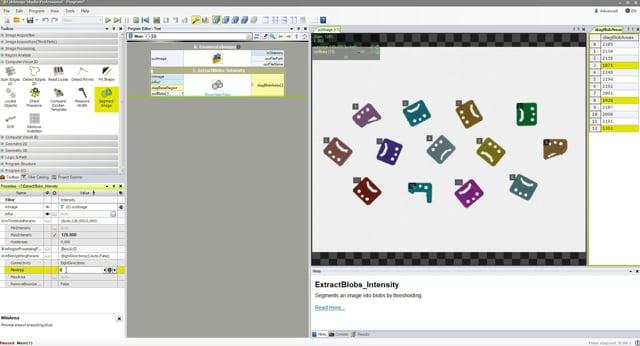

Anwendungsbeispiel

In dieser Anwendung müssen wir Nägel unter Schrauben und Muttern

erkennen. Das Bild wird mit Schwellenwerten abgeglichen und die

resultierenden Bereiche werden in sog. Blobs aufgeteilt; zuletzt werden

die Blogs nach ihrer Längenausdehnung eingestuft und die Nägel leicht

gefunden.

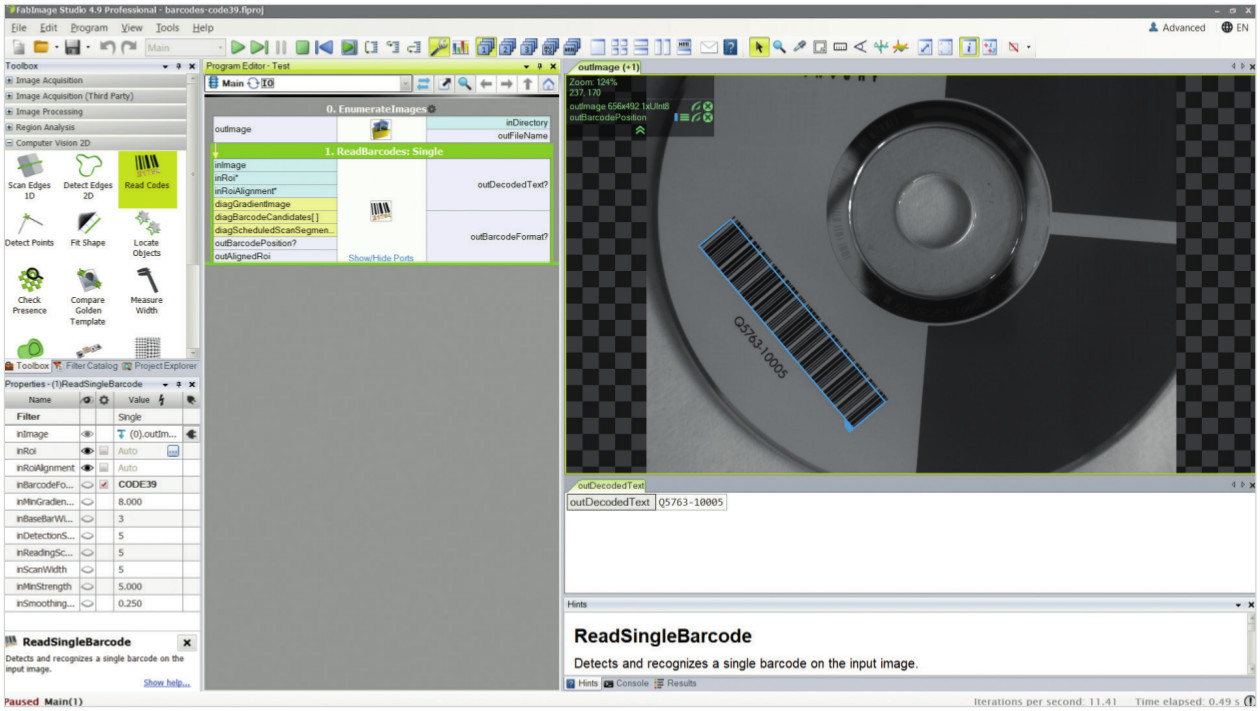

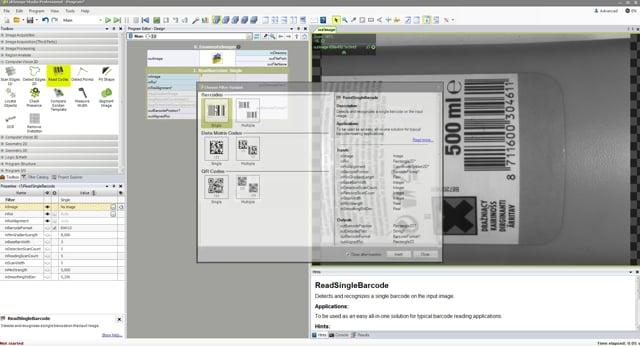

Dieses Beispiel zeigt einen einfachen ReadBarcodes-Filter. Das Tool

findet automatisch den Barcode und gibt dann den entschlüsselten Text

wieder.